「この薬の有効率は80%」「明日の降水確率は30%」——私たちは日常的に確率を目にしますが、その計算の仕組みや意味を正確に理解している人は多くありません。

この章では、統計学の根幹をなす 確率 の考え方を基礎から解説します。加法定理・条件付き確率・乗法定理・ベイズの定理まで、具体例と図解で一歩ずつ理解していきましょう。

5.1 確率とは何か

確率とは、ある出来事が起こる「可能性の大きさ」を 0 から 1 の数値で表したものです。0 は「絶対に起きない」、1 は「必ず起きる」を意味します。

P(A) = 事象Aが起こる場合の数 ÷ 全ての場合の数

例)サイコロを1回振って「3の目が出る」確率

全体の場合の数 = 6(1〜6のどれか)

3が出る場合の数 = 1

P(3) = 1 ÷ 6 ≈ 0.167(約16.7%)| 確率の値 | 意味 | 例 |

|---|---|---|

| P = 0 | 絶対に起きない | サイコロで7の目が出る |

| P = 0.5 | 半々 | コインを投げて表が出る |

| P = 1 | 必ず起きる | サイコロで1〜6のどれかが出る |

また、すべての事象の確率の合計は必ず 1 になります(確率の総和=1)。

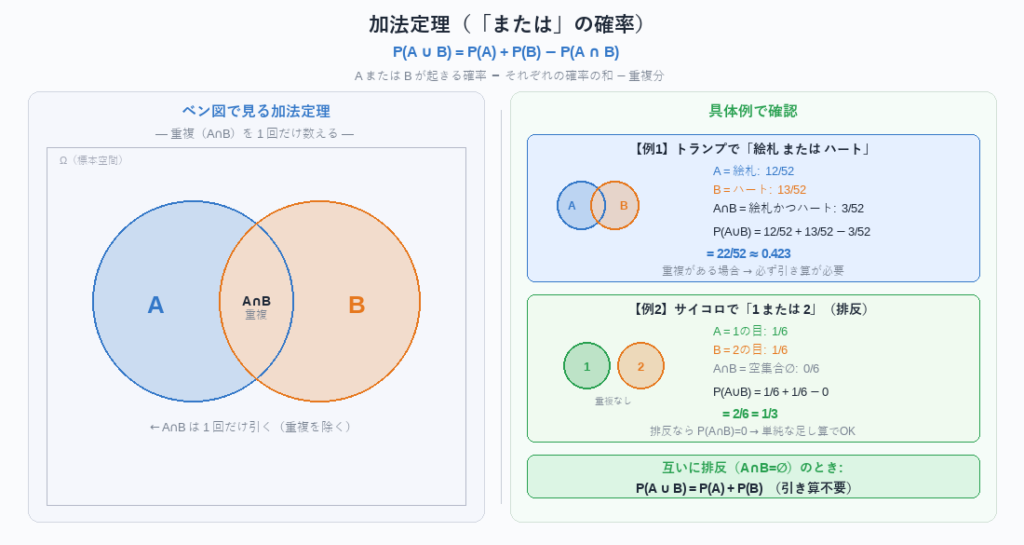

5.2 加法定理(「または」の確率)

「A または B が起こる」確率は、それぞれの確率を足すことで求められます。ただし A と B が同時に起こる場合は、その分を引いて重複をなくします。

P(A ∪ B) = P(A) + P(B) − P(A ∩ B)

例)トランプから1枚引いて「絵札またはハート」の確率

P(絵札) = 12/52 … J, Q, K × 4マーク(スート)

P(ハート) = 13/52

P(絵札かつハート) = 3/52 … ハートのJ, Q, K

P(絵札 ∪ ハート) = 12/52 + 13/52 − 3/52 = 22/52 ≈ 0.423A と B が 互いに排反の(同時に起こらない)場合は P(A∩B) = 0 なので、単純に足すだけです。

互いに排反のとき: P(A ∪ B) = P(A) + P(B)

例)サイコロで「1または6の目が出る」確率

P(1) = 1/6, P(6) = 1/6

P(1 ∪ 6) = 1/6 + 1/6 = 2/6 ≈ 0.333まとめ:「または(∪)」→ 足し算(重複がある場合は P(A∩B) を引く)

5.3 条件付き確率

「Aが起きた前提で、Bが起きる確率」

条件付き確率とは、「A が起きたという条件のもとで、B が起こる確率」のことです。記号で P(B|A)と書きます。「全体の空間」が Ω からA に絞り込まれる、とイメージすると直感的です。

P(B|A) = P(A ∩ B) / P(A) (P(A) > 0 のとき定義される)

例)トランプから1枚引いたとき

「絵札だった(A)」という条件のもと、「ハートである(B)」確率は?

P(A ∩ B) = P(絵札かつハート) = 3/52 ← ハートのJ, Q, K

P(A) = P(絵札) = 12/52

P(B|A) = (3/52) ÷ (12/52) = 3/12 = 1/4 = 0.25

→ 引いたカードが絵札とわかった時点でハートの確率は 25%

(*)この例では、どのマークでも絵札の枚数は同じのため、全体からハートを引く確率と同じ独立と条件付き確率

2つの事象 A, B が 独立(互いに影響しない)であれば、A が起きても B の確率は変わりません。条件付き確率で表すと次のようになります。

独立のとき: P(B|A) = P(B) ← A の情報がB の確率に影響しない

例)コインを2回投げる場合

1回目が表でも、2回目の表の確率は変わらず 1/2

→ 各コイン投げは独立一方、非独立(従属)の場合は A の結果によって B の確率が変化します。これが「条件付き確率が使われる主な場面」です。

例)袋の中に赤玉3個・白玉2個(計5個)から、1個ずつ2回取り出す(戻さない)

1回目が赤玉だったとき(A)、2回目も赤玉(B)の確率は?

P(B|A) = 2/4 = 0.5

→ 1回目赤を取った後、残りは赤2個・白2個(計4個)のため

P(B|Ac) = 3/4

→ 1回目白を取った後、残りは赤3個・白1個(計4個)のため

P(B|A) ≠ P(B|Aの余事象) → 2回目に取り出す色の確率が1回目の結果に依存する = 非独立ポイント:条件付き確率 P(B|A) は「A が起きたとわかったとき、話の”舞台”が Ω から A に縮小される」ことを数式で表したものです。

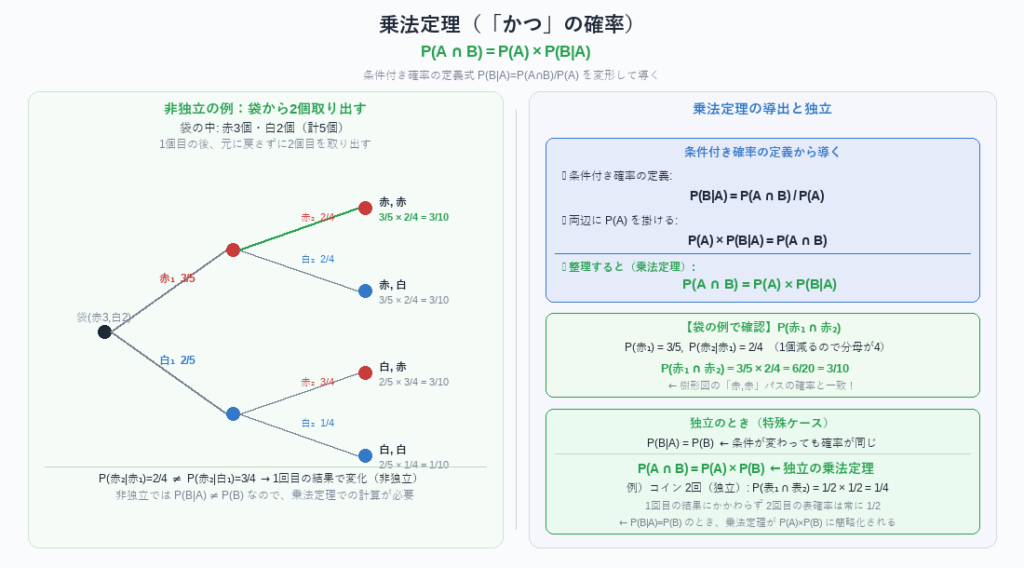

5.4 乗法定理(「かつ」の確率):条件付き確率から導く

条件付き確率の式を変形しただけ

条件付き確率の式 P(B|A) = P(A∩B)/P(A) を変形するだけで、乗法定理が得られます。

条件付き確率の定義:

P(B|A) = P(A ∩ B) / P(A)

両辺に P(A) を掛けると:

P(A ∩ B) = P(A) × P(B|A) ← 乗法定理

同様に:

P(A ∩ B) = P(B) × P(A|B) 非独立の場合(袋から玉を2個取り出す)

袋: 赤玉3個 + 白玉2個(計5個)、1個ずつ戻さずに取り出す

P(1個目赤) = 3/5

P(2個目赤 | 1個目赤) = 2/4 ← 1個目で赤を取ったので残りは赤2個

乗法定理を適用:

P(1個目赤 かつ 2個目赤) = P(1個目赤) × P(2個目赤 | 1個目赤)

= 3/5 × 2/4

= 6/20 = 3/10 = 0.30独立の場合:P(B|A) = P(B) なので掛け算が単純になる

A と B が独立のとき、P(B|A) = P(B)(条件で変わらない)なので、乗法定理は次のように簡略化されます。

独立のとき:

P(A ∩ B) = P(A) × P(B|A) = P(A) × P(B) ← P(B|A)=P(B) を代入

例)コインを2回投げて「2回とも表」の確率

P(1回目表) = 1/2, P(2回目表 | 1回目表) = 1/2 (独立なので条件で不変)

P(2回とも表) = 1/2 × 1/2 = 1/4 = 0.25まとめ:乗法定理: P(A∩B) = P(A)×P(B|A) (AとBが互いに独立の場合、P(B|A)=P(B) )

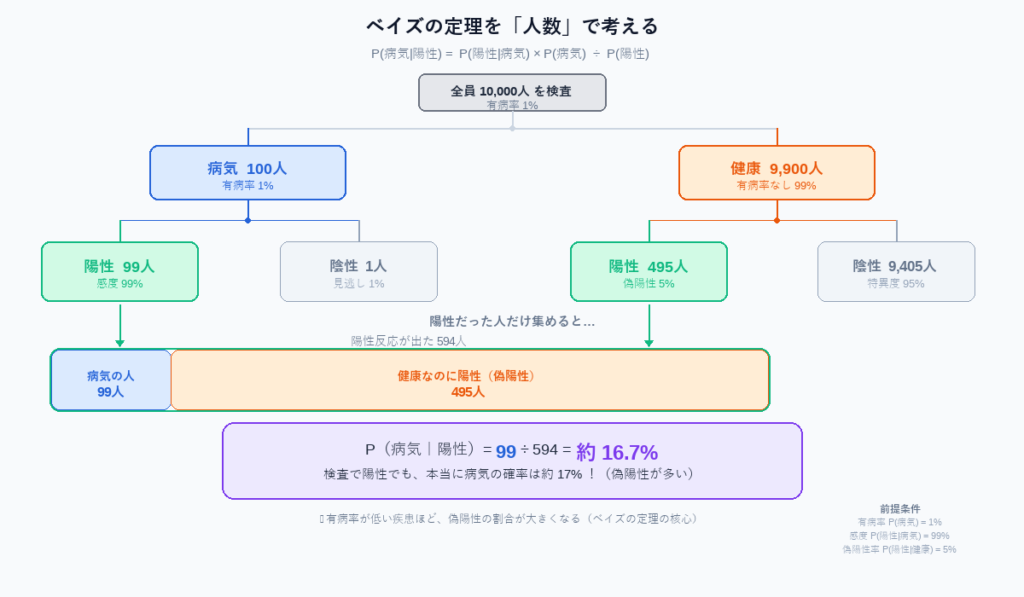

5.5 ベイズの定理:結果から原因を推定する

ベイズの定理とは

ベイズの定理は、「結果から原因の確率を推論する」ための公式です。乗法定理 P(A∩B) = P(A)×P(B|A) = P(B)×P(A|B) から導かれます。医療診断・迷惑メールフィルタ・機械学習など、現代の多くの技術の基盤となっています。

乗法定理から: P(A∩B) = P(B|A)×P(A) = P(A|B)×P(B)

両辺を P(B) で割ると:

P(A|B) = P(B|A) × P(A) / P(B) ← ベイズの定理

各要素の意味:

P(A) = Aが起こる確率(事前確率)

P(B|A) = Aが起こる条件の下でBが起こる確率

P(B) = Bが起こる確率

P(A|B) = Bが起こる条件の下でAが起こる確率(事後確率) ← 求めたいもの具体例:医療検査でのベイズの定理

「検査が陽性だったとき、本当に病気である確率は?」という問題を考えます。

前提条件:

ある病気の有病率(P(病気))= 1%(100人に1人)

検査の感度(病気のときに陽性: P(陽性|病気))= 99%

健康のときに陰性 = 95%

→ 偽陽性(健康なのに陽性) P(陽性|健康) = 5%

求めたいもの: P(病気|陽性) ← 陽性だったとき、本当に病気の確率

Step 1: P(B) = P(陽性) を全確率の法則で計算

P(陽性) = P(陽性|病気)×P(病気) + P(陽性|健康)×P(健康)

= 0.99×0.01 + 0.05×0.99

= 0.0099 + 0.0495

= 0.0594

Step 2: ベイズの定理を適用

P(病気|陽性) = P(陽性|病気) × P(病気) / P(陽性)

= 0.99 × 0.01 / 0.0594

≈ 0.167(約16.7%)検査で陽性が出ても、実際に病気である確率は約16.7%しかありません。有病率が低い病気ほど「偽陽性」が多くなるため、ベイズの定理は医療の意思決定に欠かせない考え方です。

ベイズ更新:新しい情報で確率を更新し続ける

ベイズの定理の強みは、新しい情報が得られるたびに確率を更新し続けられる点です。事後確率が次の事前確率になり、繰り返し更新することで精度が上がります。これを ベイズ更新 と言います。

| 応用分野 | A | B | A|B |

|---|---|---|---|

| 医療診断 | 有病率 | 検査結果 | 実際の罹患確率 |

| 迷惑メール | スパムの割合 | 特定の単語が含まれる | スパムである確率 |

| 機械学習 | 初期のモデルパラメータ | 学習データ | 更新後のパラメータ |

まとめ

- 確率は 0〜1 の値で「起こりやすさ」を表す。P(A) = 場合の数 / 全体の場合の数。

- 加法定理:「または(∪)」は足し算。重複がある場合は P(A∩B) を引く。

- 条件付き確率 P(B|A) = P(A∩B)/P(A) :A が起きた前提での B の確率

- 乗法定理:P(A∩B) = P(A) × P(B|A):条件付き確率の定義を変形するだけで導ける。

- 独立の場合:独立なら P(B|A)=P(B) なので P(A∩B)=P(A)×P(B) に簡略化される。

- ベイズの定理:乗法定理から導かれる。P(A|B) = P(B|A)×P(A)/P(B)。結果から原因の確率を逆算する。

- 有病率が低い病気では、検査陽性でも実際の罹患確率は低い(偽陽性問題)。

次章では、確率の考え方をさらに深めて、確率分布(二項分布・ポアソン分布)を学びます。「ランダムな現象が従うパターン」を数式で表す方法を理解しましょう。

この章の用語まとめ

| 用語(日) | 用語(英) | 意味 |

|---|---|---|

| 確率 | Probability | 事象の起こりやすさを0〜1で表した数値 |

| 事象 | Event | 確率を考える対象となる出来事 |

| 互いに排反 | Mutually exclusive | 同時には起こり得ない2つの事象の関係 |

| 独立 | Independent | P(B|A)=P(B) が成立する関係。一方の結果が他方の確率に影響しない |

| 非独立(従属) | Dependent | P(B|A)≠P(B) となる関係。一方の結果が他方の確率に影響する |

| 加法定理 | Addition rule | P(A∪B) = P(A)+P(B)−P(A∩B) |

| 条件付き確率 | Conditional probability | Aが起きたもとでBが起きる確率 P(B|A) = P(A∩B)/P(A) |

| 乗法定理 | Multiplication rule | P(A∩B) = P(A)×P(B|A) |

| ベイズの定理 | Bayes’ theorem | P(A|B) = P(B|A)×P(A)/P(B) |

| 事前確率 | Prior probability | 新しい情報を得る前の確率 |

| 事後確率 | Posterior probability | 新しい情報を得た後に更新された確率 |

コメント